Spracherkennung und Sprachsteuerung

objectiF RPM bietet die Möglichkeit Sprache über ein Mikrofon in Text umzuwandeln, der dann in ein Beschreibungsfeld eingetragen wird. Die Umsetzung erfolgt durch den Automatic Speech Recognition (ASR)-Dienst von Microsoft Azure Cognitive Services verwendet.

Für die Inbetriebnahme dieser Funktion benötigen Sie ein Microsoft Azure Konto und dessen Zugangsdaten.

Mit der Version 7.5 ist die Spracherkennung erweitert worden und ein Sprachassistent wurde integriert. Mit diesem können Sie Projektelemente, wie Diagramme, Abfragen, hierarchischen Abfragen und Sichten per Sprache suchen und sich anzeigen lassen.

Für den Sprachassistenten wird zusätzlich die Container-Plattform Docker benötigt, der auf einem Linux-Server installiert sein muss. Dort laden Sie das ab 7.5 mitgelieferte Docker-Image in den Container und starten diesen. Das Docker-Image befindet sich im Ordner: C:\Program Files (x86)\microTOOL\objectiF RPM\Server\7.5\Resources\microTOOL AI\microTOOL_AI.tar

Eine detaillierte Anleitung zur Initialisierung finden Sie in einem separaten Dokument.

Spracherkennung aktivieren und anwenden

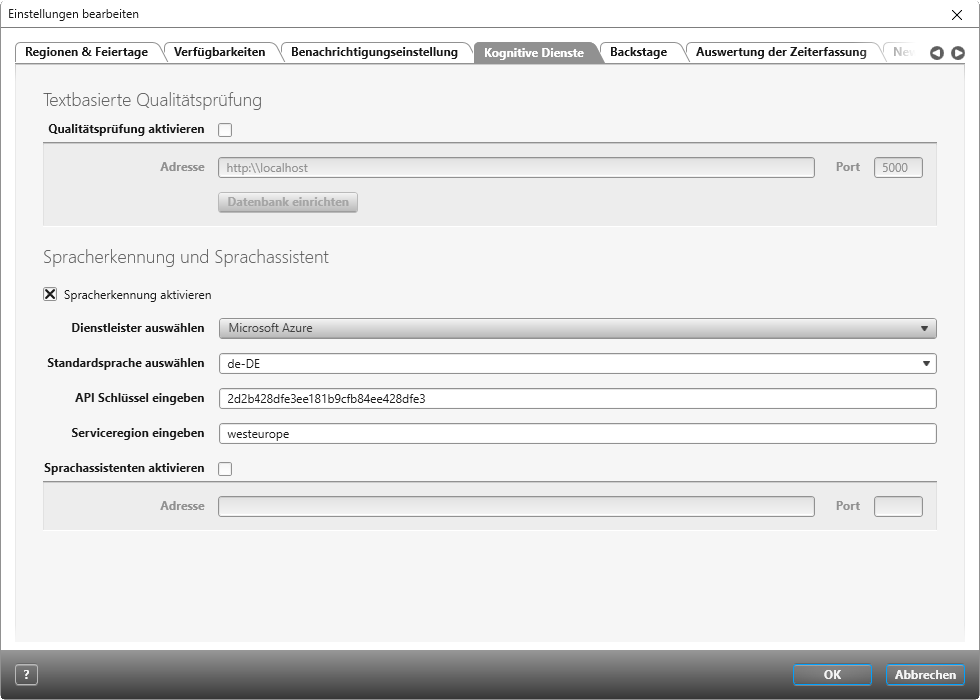

- Rufen Sie über die vertikale Funktionsleiste die Systemeinstellungen auf, indem Sie dort auf den Befehl System → Einstellungen → Allgemeine Einstellungen bearbeiten klicken.

- Wechseln Sie im Dialog Einstellungen bearbeiten in die Registerkarte Kognitive Dienste und dann in die Registerkarte Spracherkennung und Sprachassistent.

- Markieren Sie die Option Spracherkennung aktivieren.

- Stellen Sie unter Dienstleister Microsoft Azure ein.

- Wählen Sie über das Dropdown-Menü hinter Standardsprache auswählen die gewünschte Sprache aus. Die einzustellende Sprache richtet sich nach der Spracheingabe, die das Mikrofon erkennen soll.

- Geben Sie als nächstes unter API Schlüssel den API-Schlüssel von Microsoft Azure ein. Den Schlüssel können Sie in Ihrem Azure-Konto generieren und dann hier einfügen.

- Unter Serviceregion tragen Sie den Standort Ihres Azure-Kontos ein. Den Standort finden Sie ebenfalls in Ihrem Azure-Konto.

Die Spracherkennung ist jetzt in allen RTF-Editoren verfügbar und über ein Icon erreichbar. - Speichern Sie über OK.

Spracherkennung anwenden

Wenn Sie die Spracherkennung verwenden möchten, benötigen Sie ein Mikrofon. Achten Sie auf eine ruhige Umgebung, da Nebengeräusche und Unterhaltungen anderer, die Aufnahme verfälschen.

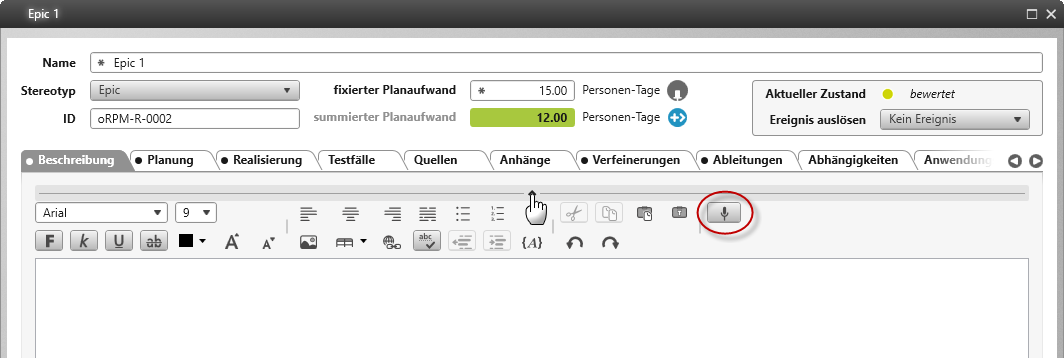

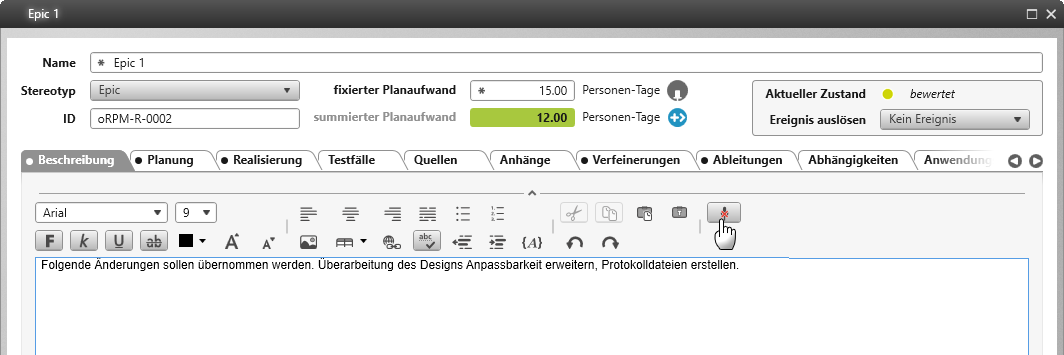

- Öffnen Sie den Bearbeitungsdialog eines Elements Ihrer Wahl.

- Wechseln Sie in ein Eingabefeld vom Typ RTF.

RTF (Rich-Text-Formatierung) sind Texteingabefelder, die verschiedene Möglichkeiten zum Formatieren von Text anbieten. - Klicken Sie auf das Mikrofon, um die Spracherkennung zu starten.

- Sprechen Sie in das Mikrofon. Sprechen Sie klar und deutlich.

- Beenden Sie die Sprachaufnahme, indem Sie erneut auf das Mikrofon klicken.

- Speichern Sie.

Sprachassistenten aktivieren und anwenden

Der Sprachassistent kann verwendet werden, um schnell auf Projektelemente in Sichten und Abfragen zuzugreifen.

Sprachassistenten aktivieren

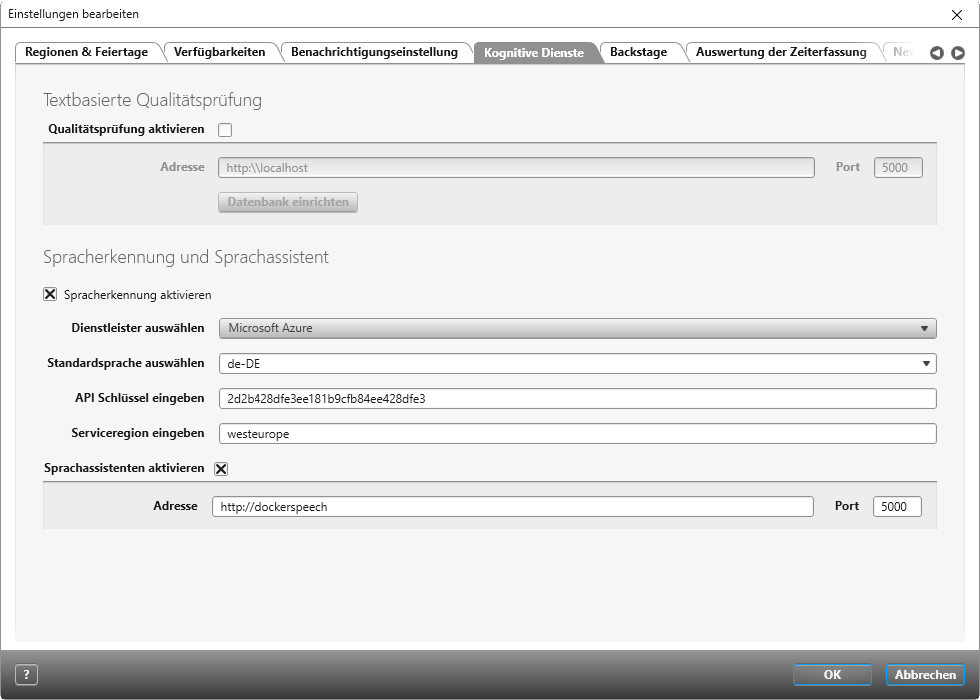

- Öffnen Sie über die vertikale Funktionsleiste die Systemeinstellungen und klicken Sie dort auf den Befehl System → Einstellungen → Allgemeine Einstellungen bearbeiten.

- Wechseln Sie im Dialog Einstellungen bearbeiten in die Registerkarte Kognitive Dienste und dann in die Registerkarte Spracherkennung und Sprachassistent.

- Markieren Sie die Option Spracherkennung aktivieren.

- Konfigurieren Sie die Spracherkennung, wie im vorherigen Abschnitt beschrieben.

- Geben Sie darunter die Adresse und den Port zum Server ein, wo der Docker Container ausgeführt wird.

- Speichern Sie den Dialog über OK.

Sprachassistenten verwenden

Wenn Sie den Sprachassistenten verwenden möchten, benötigen Sie ein Mikrofon. Achten Sie beim Sprechen auf eine klare Aussprache. Das Gesprochene wird in Text umgewandelt und im Eingabefeld ausgegeben. Wenn Wörter nicht korrekt erkannt werden, können Sie diese korrigieren, indem Sie sie überschreiben und Enter drücken. Sie können sämtliche Abfragen und Sichten, sowie Diagramme öffnen.

- Öffnen Sie ein Projekt oder eine Organisation.

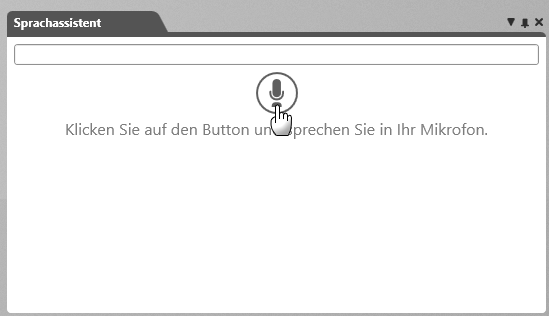

In der vertikalen Funktionsleiste wird ein Mikrofon angezeigt. - Klicken Sie auf das Mikrofon, um den Sprachassistenten zu starten.

- Um den Sprachassistenten zu aktivieren, klicken Sie im Fenster auf die Schaltfläche und sprechen in Ihr Mikrofon. Beginnen Sie in etwa so: Öffne die Abfrage Anforderungsliste. Oder Zeige Anforderungsliste.

Alternativ können Sie auch Text in das Eingabefeld eingeben.

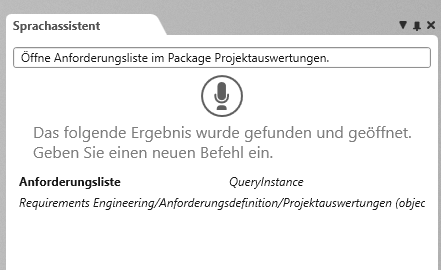

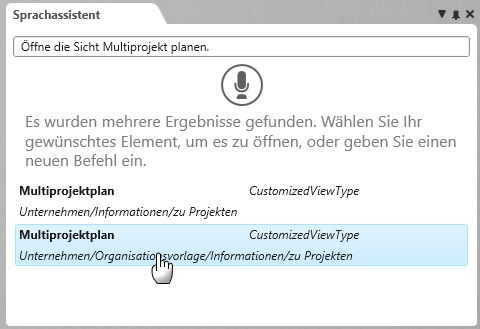

Wenn der Befehl ausgeführt bzw. Ergebnisse ermittelt werden konnten, werden diese unter dem Mikrofon ausgegeben.

Gibt es beispielsweise mehrere Ergebnisse, kann das Gesuchte per Doppelklick geöffnet werden.

Die Sicht wird wie gewohnt im mittleren Bereich geöffnet.